推荐学习书目

› Learn Python the Hard Way

Python Sites

› PyPI - Python Package Index

› http://diveintopython.org/toc/index.html

› Pocoo

值得关注的项目

› PyPy

› Celery

› Jinja2

› Read the Docs

› gevent

› pyenv

› virtualenv

› Stackless Python

› Beautiful Soup

› 结巴中文分词

› Green Unicorn

› Sentry

› Shovel

› Pyflakes

› pytest

Python 编程

› pep8 Checker

Styles

› PEP 8

› Google Python Style Guide

› Code Style from The Hitchhiker's Guide

这是一个创建于 2084 天前的主题,其中的信息可能已经有所发展或是发生改变。

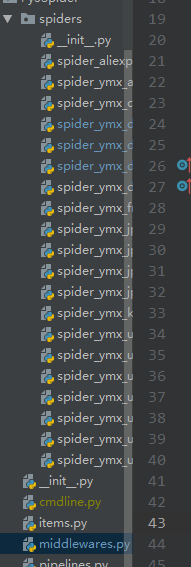

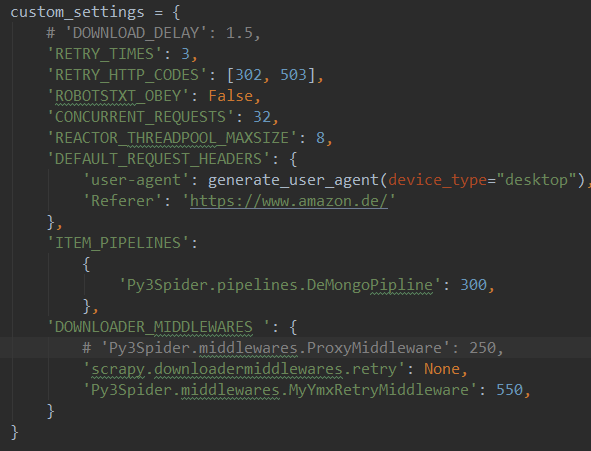

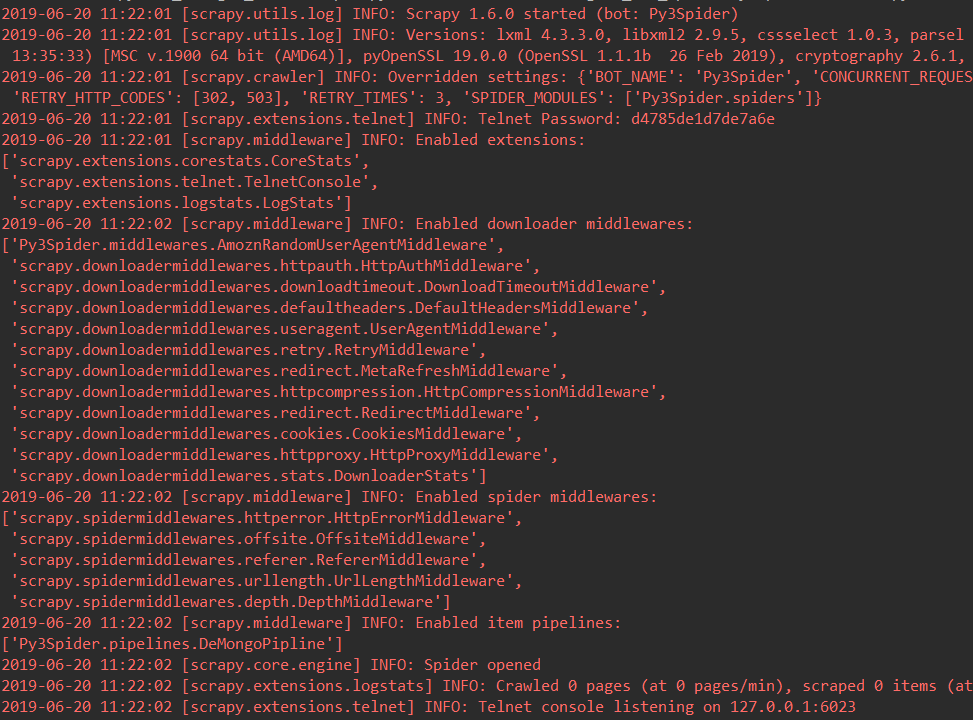

一个工程下有很多 spider 类(图一),每个类有独立的 custom_settings (图 2 ),我自定义的重试中间件没有生效(图 3 ),其他的公共的随机头,单独的 item 管道生效了。请问自定义重试中间件如何配置呢. scrapy.downloadermiddlewares.retry.RetryMiddleware 写成这样似乎也没开启

1

warcraft1236 2019-06-20 15:21:35 +08:00

550 好像大于框架自带的 retry middleware,你可以手动关闭框架自带的 retry middleware 试试

|

2

tikazyq 2019-06-20 15:23:40 +08:00 |

3

limuyan44 2019-06-20 15:35:49 +08:00 via Android

记得有些是需要关闭自带的不知道你这个有没有

|

4

wersonliu9527 OP |